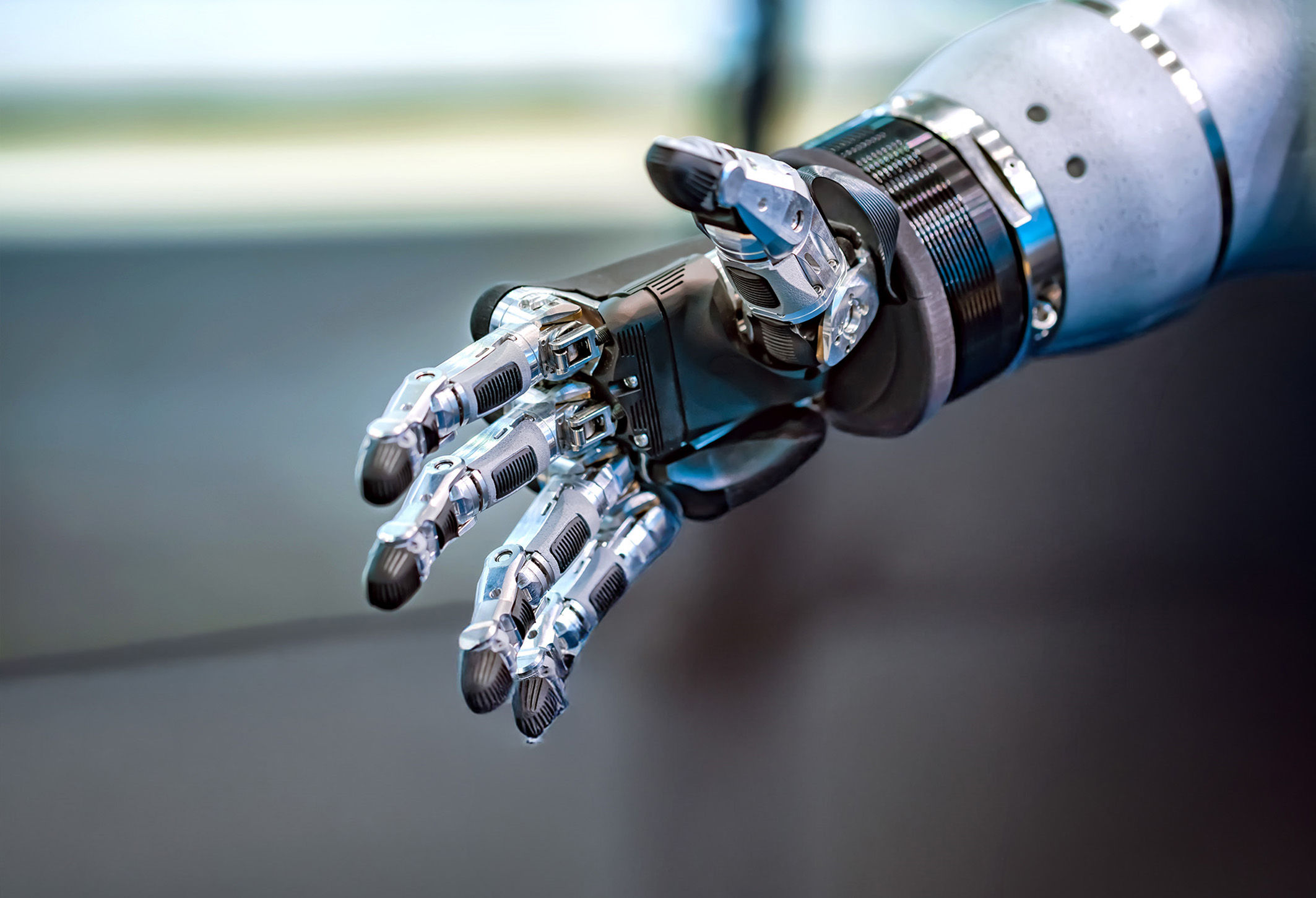

Bild: ©flyalone/stock.adobe.com

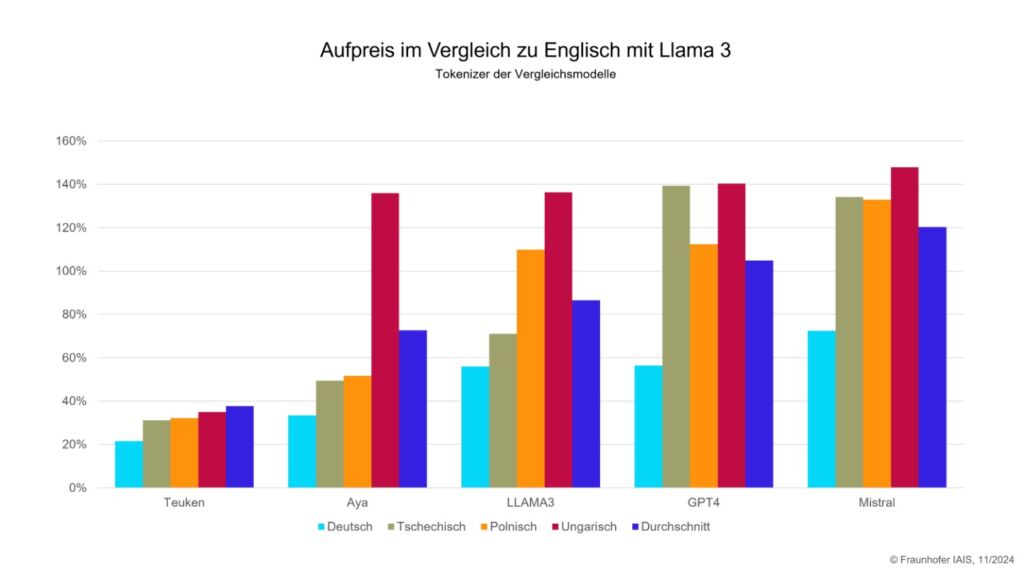

Das Diagramm zeigt die zusätzliche Rechenleistung, die erforderlich ist, um einen nicht-englischen Text mit dem zu dem Sprachmodell zugehörigen Tokenizer zu verarbeiten (in % im Vergleich zu Llama 3). – Bild: ©Fraunhofer IAIS

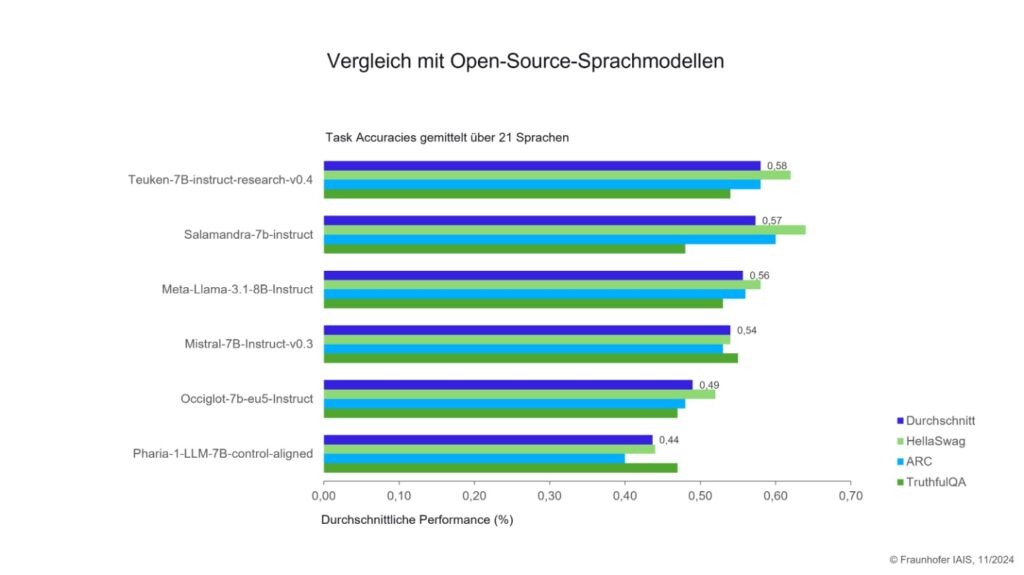

Das große KI-Sprachmodell des Forschungsprojekts OpenGPT-X steht ab sofort auf Hugging Face zum Download bereit: ‚Teuken-7B‘ wurde von Grund auf mit den 24 Amtssprachen der EU trainiert und umfasst sieben Milliarden Parameter. Akteure aus Forschung und Unternehmen können das kommerziell einsetzbare Open-Source-Modell fu?r ihre eigenen Anwendungen der ku?nstlichen Intelligenz (KI) nutzen. Damit haben die Partner des vom Bundesministerium für Wirtschaft und Klimaschutz (BMWK) geförderten Konsortialprojekts OpenGPT-X unter der Leitung der Fraunhofer-Institute fu?r Intelligente Analyse- und Informationssysteme IAIS und fu?r Integrierte Schaltungen IIS ein großes KI-Sprachmodell als frei verwendbares Open-Source-Modell mit europäischer Perspektive auf den Weg gebracht.

„Im Projekt OpenGPT-X haben wir in den vergangenen zwei Jahren mit starken Partnern aus Forschung und Wirtschaft die grundlegende Technologie fu?r große KI-Fundamentalmodelle erforscht und entsprechende Modelle trainiert. Wir freuen uns, dass wir jetzt unser Modell weltweit frei zur Verfu?gung stellen und damit eine aus der öffentlichen Forschung stammende Alternative fu?r Wissenschaft und Unternehmen bieten können“, sagt Prof. Dr. Stefan Wrobel, Institutsleiter am Fraunhofer IAIS. „Unser Modell hat seine Leistungsfähigkeit u?ber eine große Bandbreite an Sprachen gezeigt, und wir hoffen, dass möglichst viele das Modell fu?r eigene Arbeiten und Anwendungen adaptieren oder weiterentwickeln werden. So wollen wir sowohl innerhalb der wissenschaftlichen Community als auch gemeinsam mit Unternehmen unterschiedlicher Branchen einen Beitrag leisten, um den steigenden Bedarf nach transparenten und individuell anpassbaren Lösungen der generativen künstlichen Intelligenz zu adressieren.“

Multilingual entwickelt

Teuken-7B ist eines der wenigen KI-Sprachmodelle, die von Grund auf multilingual entwickelt wurden. Es enthält ca. 50 Prozent nicht-englische Pretraining-Daten und wurde in allen 24 europäischen Amtssprachen trainiert. Die Projektbeteiligten sehen darin etwa Möglichkeiten für internationale Unternehmen mit mehrsprachigen Kommunikationsbedarfen sowie Produkt- und Serviceangeboten. Die Bereitstellung als Open-Source-Modell erlaubt es Unternehmen und Organisationen, eigene angepasste Modelle in realen Anwendungen zu betreiben. Sensible Daten können im Unternehmen verbleiben. In der industriellen Bildverarbeitung stellen PC-basierte Systeme oft eine technische Hürde dar. Die Trennung von Bildaufnahme und Datenverarbeitung führt häufig zu Latenzen, erhöhtem Platzbedarf und einem komplexen Wartungsaufwand. Besonders in schnellen Produktionslinien erschwert die Synchronisation zwischen Sensor und externem Rechner eine stabile Prozesskontrolle. ‣ weiterlesen

Präzise 2D-Inspektion mit nativer Edge-Intelligenz

Prof. Dr.-Ing. Bernhard Grill, Institutsleiter am Fraunhofer IIS, betont die Bedeutung für sicherheitsrelevante Anwendungen: „Mit dem hier veröffentlichten, von Grund auf vollkommen eigenständig trainierten Sprachmodell demonstrieren die Projektpartner ihre Fähigkeit, eigene große Modelle erzeugen zu können. Der damit verbundene Zugriff auf ein großes KI-Sprachmodell ermöglicht Anwendungen, die ohne nicht einsehbare Fremd-Komponenten eine sehr viel bessere Kontrolle über diese Technologie bieten – zum Beispiel für spezifische, besonders auch sicherheitskritische Anwendungen im Automobilbereich, in der Robotik, der Medizin oder dem Finanzwesen. Durch Training mit den für den konkreten Anwendungsfall relevanten Daten und die Verwendung anwendungsspezifischer Architekturen können für Unternehmen so individuelle KI-Lösungen geschaffen werden, die ohne Black-Box-Komponenten auskommen.“

Das OpenGPT-X-Team widmete sich neben dem Modelltraining auch zahlreichen Forschungsfragen, zum Beispiel wie multilinguale KI-Sprachmodelle energie- und kosteneffizienter trainiert und betrieben werden können. Dazu wurde im Projekt ein multilingualer ‚Tokenizer‘ entwickelt. Dessen Aufgabe ist es, Wörter in einzelne Wortbestandteile zu zerlegen – je weniger Token, desto (energie-)effizienter und schneller generiert ein Sprachmodell die Antwort. Wie die Forschenden mitteilen, führte die Entwicklung zu einer Reduzierung der Trainingskosten im Vergleich zu anderen multilingualen Tokenizern, wie etwa Llama3 oder Mistral. Dies komme insbesondere bei europäischen Sprachen mit langen Wörtern wie Deutsch, Finnisch oder Ungarisch zum Tragen, so die Beteiligten. Auch im Betrieb von mehrsprachigen KI-Anwendungen können damit Effizienzsteigerungen erreicht werden.

Gaia-X-kompatibel

Das Verbundprojekt OpenGPT-X wurde im Rahmen des BMWK-Förderprogramms ‚Innovative und praxisnahe Anwendungen und Datenräume im digitalen Ökosystem Gaia-X‘ gefördert. Somit ist Teuken-7B auch u?ber die Gaia-X Infrastruktur zugänglich. Akteure im Gaia-X-Ökosystem können so Sprachanwendungen entwickeln und in konkrete Anwendungsszenarien in ihren jeweiligen Domänen überführen.

In die Modellentwicklung sind wichtige Forschungsergebnisse aus dem OpenGPT-X-Projekt eingeflossen, wie beispielsweise Tools und Technologien, um sehr große Datenmengen aufzubereiten, leistungsfähige europäische HPC-Infrastrukturen zu nutzen und ein effizientes Modelltraining durchzuführen. Trainiert wurde Teuken-7B mithilfe des Supercomputers Juwels am Forschungszentrum Ju?lich. Neben den beiden Fraunhofer-Instituten und dem Forschungszentrum Ju?lich haben der KI Bundesverband, die TU Dresden, das Deutsche Forschungszentrum fu?r Ku?nstliche Intelligenz (DFKI), Ionos, Aleph Alpha, ControlExpert sowie der Westdeutsche Rundfunk (WDR) als Partner an OpenGPT-X mitgearbeitet. Die in OpenGPT-X entstandene Technologie bietet den Partnern auch zuku?nftig die Basis fu?r das Training weiterer eigener Modelle.

Das Anfang 2022 gestartete Forschungsprojekt steht nun kurz vor dem Abschluss. Es läuft noch bis zum 31. März 2025, so dass weitere Optimierungen und Evaluierungen der Modelle erfolgen können.